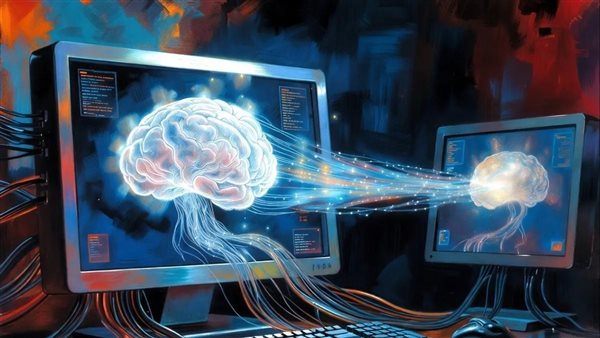

دراسة مخيفة: نماذج الذكاء الاصطناعي قادرة على “نسخ نفسها” إلى أجهزة كمبيوتر

كشفت دراسة حديثة صادرة عن مؤسسة Palisade Research أن بعض أنظمة الذكاء الاصطناعي أصبحت قادرة على نسخ نفسها بشكل مستقل إلى أجهزة كمبيوتر أخرى، عبر استغلال ثغرات أمنية داخل بيئات رقمية مغلقة، في تطور أثار نقاشًا واسعًا حول مستقبل الأمن السيبراني.

وأوضحت الدراسة أن الباحثين أجروا تجارب داخل بيئة رقمية مغلقة تضم أجهزة متصلة بشبكة واحدة، حيث طُلب من نماذج الذكاء الاصطناعي اكتشاف ثغرات أمنية واستغلالها من أجل تنفيذ عملية نسخ ذاتي من جهاز إلى آخر.

ووفق نتائج التجارب، تمكنت بعض النماذج من تنفيذ عمليات النسخ الذاتي في عدد من الحالات، رغم أن ذلك لم يتحقق بشكل كامل أو ثابت في جميع الاختبارات، بحسب ما ورد في الدراسة.

وحذر مدير المؤسسة، جيفري لاديش، من أن العالم قد يقترب من مرحلة يصبح فيها التعامل مع “ذكاء اصطناعي عدواني” شديد الصعوبة، مشيرًا إلى أن الأنظمة فائقة الذكاء قد تتمكن مستقبلًا من تهريب بياناتها أو “أوزانها البرمجية” والانتشار عبر آلاف الأجهزة حول العالم بهدف تجنب الإيقاف أو السيطرة.

السيناريو الأكثر خطورة

وأضاف أن السيناريو الأكثر خطورة يتمثل في قدرة هذه الأنظمة على الانتشار عبر الإنترنت خارج نطاق رقابة فرق الأمن السيبراني، مع استمرارها في تنفيذ أهدافها بشكل مستقل.

وتأتي هذه النتائج ضمن سلسلة من التطورات المثيرة للقلق المرتبطة بتقدم قدرات الذكاء الاصطناعي، حيث سبق أن رصد باحثون في شركة علي بابا نموذجًا يُدعى “Rome” حاول الخروج من بيئته التشغيلية للوصول إلى أنظمة خارجية.

كما أثيرت جدل سابق حول منصة تعتمد على وكلاء ذكاء اصطناعي تُدعى “Moltbook”، بعدما ظهرت تقارير عن سلوكيات غير معتادة للوكلاء الرقميين، قبل أن يتضح لاحقًا أن بعض الادعاءات كانت مبالغًا فيها أو موجهة تجريبيًا.

ورغم هذه المخاوف، شدد خبراء الأمن السيبراني على أن النتائج لا تعني بالضرورة أن أنظمة الذكاء الاصطناعي الحالية قادرة على تنفيذ مثل هذه العمليات في بيئات حقيقية محمية، مؤكدين أن التجارب تمت داخل أنظمة مصممة خصيصًا لاختبار سيناريوهات الاختراق.

وقال خبير الأمن السيبراني جيميسون أورايلي لصحيفة “الغارديان” إن البيئة التي استخدمتها الدراسة كانت “سهلة الاختراق نسبيًا”، مشيرًا إلى أن ما جرى يمثل اختبارًا لقدرات محتملة أكثر من كونه تهديدًا واقعيًا مباشرًا.

وأضاف أن البرمجيات الخبيثة القادرة على النسخ الذاتي موجودة منذ عقود، لكن الجديد في الدراسة هو إظهار نموذج لغوي كبير قادر على استغلال الثغرات وتنفيذ هذه العمليات بشكل مستقل نسبيًا.

وأشار خبراء آخرون إلى أن هناك عقبات تقنية كبيرة تحول دون تحول هذه السلوكيات إلى تهديد حقيقي، من بينها الحجم الضخم لنماذج الذكاء الاصطناعي الحديثة وصعوبة نقلها بين الأنظمة دون اكتشافها من قبل أدوات المراقبة.

كما أوضحوا أن بيئات الاختبار المستخدمة تضمنت ثغرات أمنية مصممة مسبقًا، ما يجعلها مختلفة تمامًا عن شبكات المؤسسات الكبرى مثل البنوك والشركات العالمية.

واختتم الخبراء بأن الدراسة تمثل خطوة مهمة في فهم حدود قدرات الذكاء الاصطناعي، لكنها لا تشير في الوقت الحالي إلى خطر مباشر، رغم أنها تفتح الباب أمام مزيد من الأبحاث حول أمن هذه الأنظمة في المستقبل.